ガウス過程による回帰(Gaussian Process Regression, GPR)について、pdfとパワーポイントの資料を作成しました。データセットが与えられたときに、GPRで何ができるか、GPRをどのように計算するかが説明されています。pdfもスライドも自由にご利用ください。

pdfファイルはこちらから、パワーポイント(pptx)ファイルはこちらからダウンロードできます。

興味のある方はぜひ参考にしていただき、どこかで使いたい方は遠慮なくご利用ください。

GPRの概要

- 線形の回帰分析手法

- カーネルトリックにより非線形の回帰モデルに

- 目的変数の推定値だけでなく、その分散も計算できる

- クロスバリデーションがいらない

スライドのタイトル

- ガウス過程による回帰 (GPR) とは?

- GPRを理解するための大まかな流れ

- 説明に入る前に:GPRがとっつきにくい理由

- 線形モデルの仮定

- 簡単にするため、まずは X を1変数とする

- 回帰係数が正規分布に従うと仮定

- b の例

- サンプル間の y の関係を考える

- y の平均ベクトルと分散共分散行列

- ② 平均ベクトルと分散共分散行列の計算

- ② y の平均ベクトルと分散共分散行列 まとめ

- ② 何を意味するか?

- ② サンプルを生成してみる

- ② サンプリング

- ② サンプリングの結果

- ② 説明変数の数を複数に

- ② yの平均ベクトルと分散共分散行列の計算

- ② yの平均ベクトルと分散共分散行列 まとめ

- 非線形モデルへの拡張

- カーネルトリック

- ③ カーネル関数の例

- ③ 非線形モデルのサンプリングの結果

- y に測定誤差を仮定

- yobsの平均ベクトル

- ④ yobsの分散共分散行列

- ④ yobsの分散共分散行列 まとめ

- ④ GPRのカーネル関数の特徴

- ④ GPRで使われるカーネル関数の例

- ④ GPRで使われるカーネル関数の例

- ④ GPRで使われるカーネル関数の例

- 問題設定

- 方針

- ⑤ 方針 まとめ

- ⑤ 用いる関係式

- ⑤ 同時分布 p( yobs,n+1 )

- ⑤ 条件付き分布 p( yobs(n+1) | yobs )

- GPRの使い方

- 精度 β

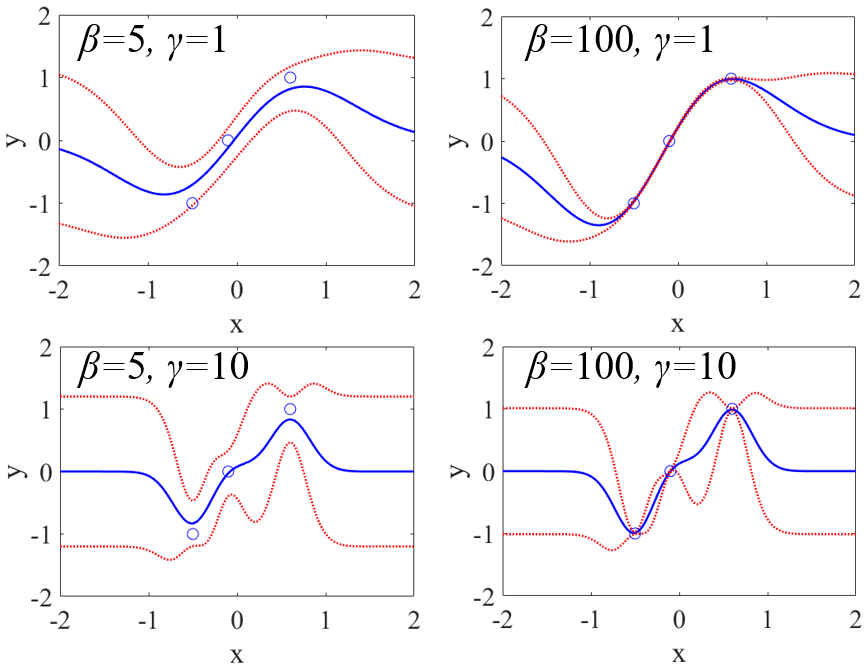

- GPRの数値例

- GPRの数値例の結果

- ハイパーパラメータの決め方 1/2

- ハイパーパラメータの決め方 2/2

- カーネル関数の決め方

参考資料

- C.M. ビショップ,パターン認識と機械学習 下, 丸善出版 (2012)

- http://scikit-learn.org/stable/modules/gaussian_process.html

- https://scikit-learn.org/stable/modules/generated/sklearn.gaussian_process.GaussianProcessRegressor.html

- https://en.wikipedia.org/wiki/Mat%C3%A9rn_covariance_function

GPR の Pythonのプログラムは、こちらをご参照ください。

以上です。

質問・コメントがありましたら、twitter・facebook・メールなどを通して教えていただけるとうれしいです。