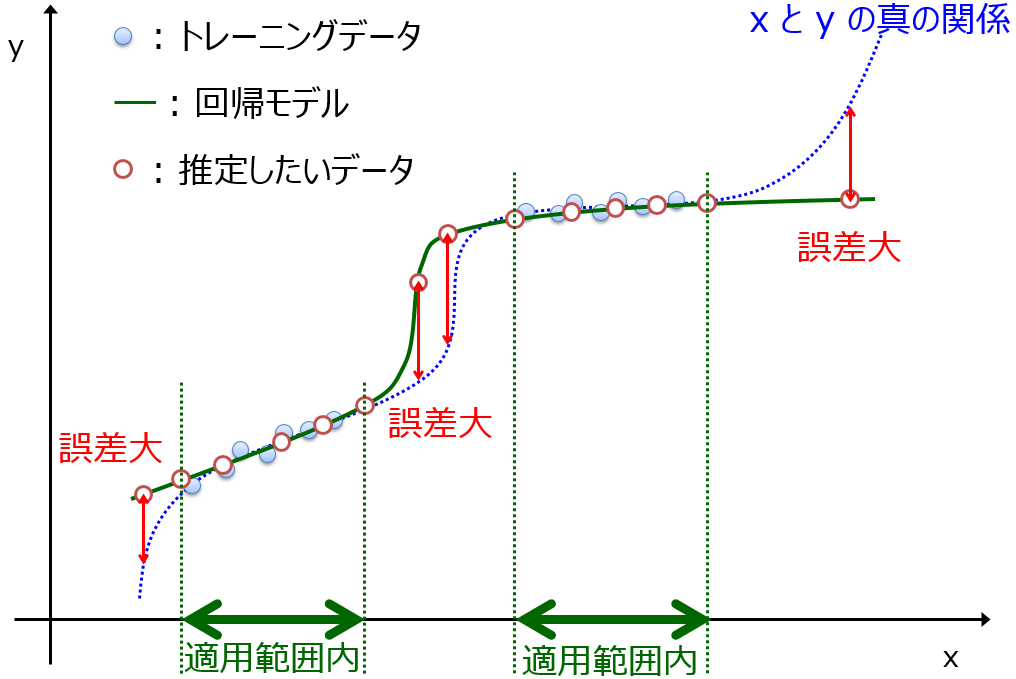

分子設計・材料設計・プロセス設計において、最初の実験・シミュレーションの合成条件・製造条件・プロセス条件などを実験計画法により決め、実験やシミュレーションをしたあとに得られるデータを用いて、特徴量 x と材料の物性・活性・特性 y との間で数理モデル y = f(x) を構築します。モデルを用いることで x から y の予測が可能になったり、モデルの逆解析により y が目標値となる x の値を設計できたりします。逆解析のとき、モデルの適用範囲 (Applicability Domain, AD) の中で x を設計したり、

y の目標値が高いときにはベイズ最適化を行ったりします。

直接的逆解析により y の目標値から直接的に x の値を予測することもできます。

x の値が求められた後は、その合成条件・製造条件・プロセス条件で実験やシミュレーション行い、y のデータを獲得します。(すべての) y が目標値を達成するまで、これらのモデル構築、x の設計、実験・シミュレーションを繰り返し、所望の材料の開発を目指します。この繰り返しが適応的実験計画法です。

x と y の間でモデルを構築するとき、すべての x が y に寄与しているとは限りません。y とまったく関係のない x が入ってしまうと、モデルに対してノイズとして作用し、モデルの予測精度が低下してしまいます。

そこで、特徴量選択によって y と関連のある重要な x のみ選択する試みがなされています。

選択された x のみでモデルを構築するということは、選択されなかった x はまったくモデルに反映されないことを意味します。このため、適応的実験計画法において、一般的には特徴量選択をせず、すべての x を用いることが多いです。ただし、特徴量選択をすることで予測精度の高いモデルを構築できる場合は、特徴量選択をしても問題ないと考えています。

ただし、2つ注意点があります。

一つは、選択されなかった x を一定の値に固定しないことです。次の合成条件・製造条件・プロセス条件を設計するとき、選択された x はモデルの逆解析により値を決めることができますが、特徴量選択で選択されなかった x は値が決まりません。この設計されなかった x に何か一定の値を与えるのではなく、例えばランダムに振った値にするとよいです。このようにすることで、次の実験やシミュレーションで得られたデータを追加して再度特徴量選択をするとき、前は選択されなかった x でも次は選択されるかもしれません。

特徴量選択や特徴量重要度やモデル構築は万能ではありません。本質的に重要な特徴量でも、サンプル数が小さかったり、他の特徴量に埋もれてしまったりして、重要度が低く見積もられてしまい、選択されないこともあります。選択されなかった x の値を一定値に固定してしまうと、本来は重要にもかかわらず誤って省かれてしまった x が、日の目を見ないままになってしまいます。選択されなかった x の値をばらつかせることで、その実験データが追加された後に、x のばらつきの結果 y が有意に変化したかという結果を持って、重要な可能性のある x を再度検討できます。

この意味では、例えば (実験計画法の前に) 最初に大量にサンプルを生成したとき、これは特徴量選択の前のためすべての x で値がばらついていますので、その大量のサンプルを使い続ける、すなわち特徴量選択後も元のサンプルにおける選択されなかった特徴量の値は変えない、というやり方が手間も少なく便利かもしれません。

もう一つの注意点は AD の設定です。AD は、特徴量選択で選択された x のみを用いて設定するので問題ありません。一般的に x の数が減ることで AD は広くなります。言い換えると、より多くのサンプルが AD 内に入りやすくなります。なるべく多くのサンプルから次の実験条件やシミュレーション条件を検討するため、選択された少数の x のみで AD を設定するとよいでしょう。

ただし1つ目の注意点で説明したように、AD 内で x を設計できた場合でも、選択されなかった x は値を (ランダムに) 振りましょう。ここで、選択されなかった x を含めた AD を考慮する必要はありません。モデルは選択された x のみで構築されており、AD はモデルに紐づいていますので、選択されなかった特徴量は考えなくて構いません。

適応的実験計画法において特徴量選択をする2つの注意点が参考になれば幸いです。

以上です。

質問やコメントなどありましたら、twitter, facebook, メールなどでご連絡いただけるとうれしいです。